Quando due gameplay non sono più lo stesso gioco. DLSS 5 e modello generativo

Per anni abbiamo dato per scontata una cosa molto semplice. Se due persone giocano la stessa scena, nello stesso punto, con lo stesso input, vedono la stessa immagine.

Non è più vero.

Con DLSS 5 non siamo davanti all’ennesimo step evolutivo di upscaling o frame generation. Quello si è chiuso con le versioni precedenti. Qui cambia la natura stessa del rendering. L’immagine finale non è più la diretta conseguenza della scena renderizzata, ma il risultato di un processo di inferenza. Tradotto: la GPU non si limita a migliorare ciò che c’è. Decide cosa dovrebbe esserci.

E questo rompe qualcosa di fondamentale.

Non è più ricostruzione, è interpretazione

Nel rendering classico, anche con ray tracing o path tracing, il risultato resta una funzione deterministica. Cambiano i metodi, cambia il costo computazionale, ma la logica è sempre la stessa: stessi input, stesso output.

DLSS 5 introduce un livello che non ricostruisce, ma completa. Riempie. Interpreta.

La superficie del legno non è più solo quella calcolata dallo shader. È quella che il modello ritiene plausibile. La pelle, i riflessi, la luce indiretta non sono solo simulati. Sono stimati.

Finché si tratta di qualità visiva, è un vantaggio. Quando si guarda la coerenza, diventa un problema.

Il punto critico del DLSS 5: due gameplay possono divergere

Immagina questa situazione: stessa build, stessa scena, stesso percorso.

Due giocatori registrano lo stesso momento.

Il gameplay è identico. Le hitbox, le collisioni, la logica di gioco non cambiano. Ma l’immagine sì. Non in modo plateale, ma abbastanza da creare differenze reali.

Un riflesso più marcato. Una texture più dettagliata. Una zona d’ombra più chiusa o più aperta.

Sono micro-variazioni, ma sono variazioni. E soprattutto non sono garantite come identiche tra due esecuzioni.

Non si sta più guardando una copia del mondo. Si sta guardando una sua interpretazione.

Stesso prompt, due risultati

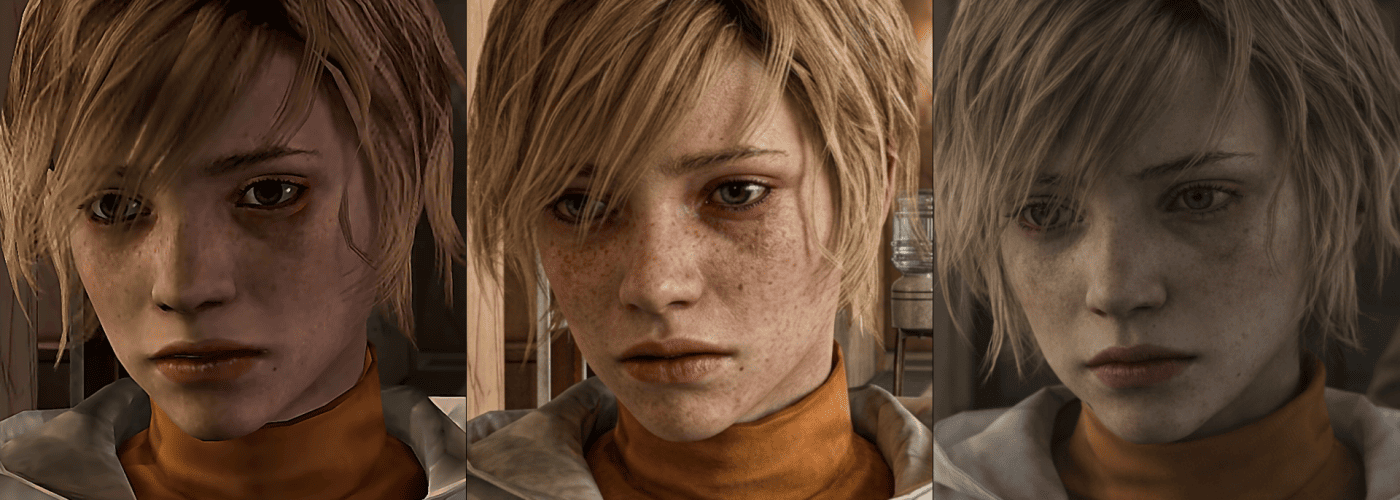

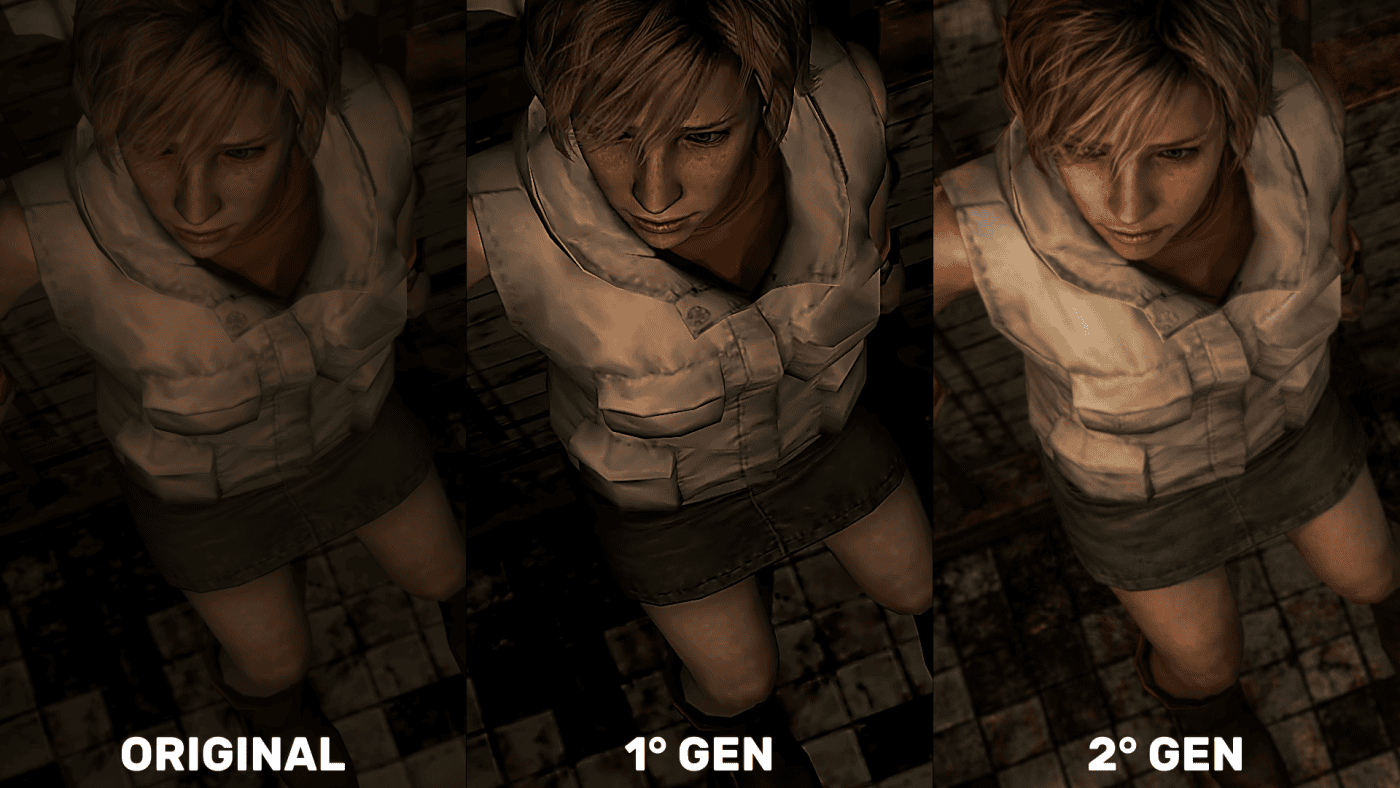

Per chiarire questo punto, basta un esperimento semplice.

Il setup è volutamente minimale, senza alcun tentativo di vincolare il modello o limitare la sua naturale tendenza a introdurre variazioni.

Si prende lo stesso frame dal gioco, si applica lo stesso identico prompt e si esegue la generazione due volte.

Il risultato, come prevedibile, non è identico.

Non perché qualcosa sia andato storto, ma perché il modello non ricostruisce: interpreta. Ogni inferenza produce una variazione plausibile, coerente con la scena, ma non perfettamente sovrapponibile.

È esattamente qui che avviene la rottura.

Lo stesso input non garantisce più lo stesso output.

Ed è lo stesso principio che, portato all’interno di una pipeline come DLSS 5, apre a una possibilità molto concreta: due esecuzioni dello stesso momento di gameplay potrebbero non produrre la stessa immagine.

Streaming: la realtà si frammenta ancora di più

Ora aggiungi lo streaming.

La pipeline diventa: gioco → DLSS 5 → compressione → piattaforma → decompressione

L’AI aggiunge dettagli. La compressione li distrugge o li altera. Il viewer riceve una versione ulteriormente reinterpretata.

Due streamer che giocano lo stesso identico punto possono mostrare due immagini diverse. E chi guarda vede una terza versione ancora.

Non è un bug. È una conseguenza naturale del sistema.

Perché questo cambia davvero le cose

Finché il rendering è deterministico, esistono alcune garanzie implicite:

- un replay è verificabile

- uno screenshot è affidabile

- un bug visivo è riproducibile

- l’art direction è sotto controllo

Con un sistema generativo, queste garanzie si indeboliscono.

Non spariscono, ma diventano probabilistiche.

Il QA diventa più complesso. Il competitivo diventa più ambiguo. Il controllo artistico si sposta, almeno in parte, fuori dal motore.

È possiamo tenerlo sotto controllo?

La risposta è sì, ma non gratis.

Per mantenere coerenza, serve introdurre vincoli. Non sul rendering classico, ma sull’AI stessa.

Si può forzare un comportamento deterministico introducendo un seed legato alla scena e al frame. In questo modo, a parità di condizioni, l’inferenza produce sempre lo stesso risultato.

Si può bloccare la storia temporale, evitando che piccoli errori si accumulino e generino drift visivo nel tempo.

Si possono separare le zone critiche da quelle libere. Personaggi, armi, elementi di gameplay restano sotto rendering rigido. L’ambiente può essere lasciato alla libertà generativa.

Si possono passare all’AI vincoli semantici. Un volto resta un volto. Un’arma mantiene la sua forma. Il resto può variare.

E nei replay o negli ambienti competitivi si può registrare e sincronizzare lo stato dell’inferenza stessa, non solo input e frame.

Sono tutte soluzioni possibili. Nessuna è gratuita.

La reale direzione del rendering generativo DLSS 5

DLSS 5 non è solo una tecnologia grafica. È un cambio di filosofia.

Il rendering smette di essere una rappresentazione diretta della scena e diventa una mediazione tra dati e percezione. L’obiettivo non è più mostrare ciò che è stato calcolato, ma ciò che dovrebbe apparire corretto.

Finché funziona, “è magia”. Quando si confrontano due versioni della stessa realtà, si capisce che non è più la stessa cosa.

Per anni abbiamo discusso di risoluzione, frame rate, ray tracing. Parametri tecnici, misurabili, oggettivi.

Ora la domanda cambia.

Non è più: “quanto è fedele l’immagine?”

Ma: “quanto è condivisa?”

Perché nel momento in cui due persone non vedono più esattamente la stessa scena, il rendering non è più solo tecnologia. È un’interpretazione.

E a quel punto il discorso esce dal tecnico.

La mia personale considerazione

Da secoli i filosofi si interrogano su una domanda semplice e inquietante: due individui stanno davvero percependo lo stesso mondo durante la sua osservazione, oppure sono solo versioni compatibili tra loro?

Fino a ieri era un dubbio astratto. Oggi, per la prima volta, iniziamo ad avere un sistema che rende questa differenza concreta, misurabile, riproducibile.

Non è più solo una questione di percezione. È parte della pipeline grafica.